La smart city et les dispositifs de surveillance : dialogue avec Myrtille Picaud et Régis Chatellier

Le déploiement massif de technologies numériques dans l’espace urbain fait émerger de nouvelles problématiques liées à l’usage des données. Fondée sur des modèles économiques émergents, l’exploitation des données récoltées dans les espaces urbains, publics ou privés, soulève de nombreuses questions politiques et éthiques. La reconnaissance faciale cristallise à ce titre les craintes d’une smart city aux dérives autoritaires péchant par excès de sécurité.

Lors d’un évènement organisé le 10 septembre 2019, La Fabrique de la Cité a invité Régis Chatellier, chargé d’études prospectives à la CNIL, et Myrtille Picaud, chercheuse postdoctorante à la chaire « Villes et numérique » de l’École urbaine de Sciences Po, à débattre de la question de la compatibilité de la smart city avec les principes démocratiques.

La Fabrique de la Cité : Le déploiement de nouvelles technologies dans l’espace public a-t-il un effet direct sur le comportement des individus ?

Régis Chatellier : Avant d’en venir à la question de la ville, il me semble important de souligner que la surveillance permise par la technologie produit depuis relativement longtemps des effets sur les individus. En 2016, l’université d’Oxford a ainsi publié une étude dans laquelle était constatée la baisse de la fréquentation des pages Wikipédia consacrées au terrorisme à la suite de l’affaire Snowden, les individus craignant désormais la surveillance de leur navigation en ligne par les États, plus précisément une mauvaise interprétation algorithmique d’un intérêt pour les sujets liés au terrorisme. Il existe même un terme pour décrire la modification de son comportement en ligne induit par la peur de se voir prêter des intentions répréhensibles : il s’agit du chilling effect.

Myrtille Picaud : Au sein de la ville, la récolte de plus en plus massive de données affecte la définition de la norme, même si elle ne modifie pas nécessairement les comportements individuels, et participe ainsi à la prescription de ce qui serait, sur le plan collectif, un usage approprié de l’espace public. La question de la lumière dite intelligente dans la ville me semble à ce titre un exemple pertinent. Le fait de mettre en place des capteurs sur les lampadaires, afin qu’ils s’allument précisément au moment où quelqu’un passe, suggère que la rue est avant tout un espace de passage. Une technologie dont l’objectif premier est l’économie d’énergie ou éventuellement la sécurité participe donc à définir les futurs désirables de la ville et de ses espaces publics et cherche à orienter activement les comportements. L’espace public est essentiellement considéré, la nuit, comme un lieu de passage et non un espace que l’on occuperait. En cela, les usages de dispositifs technologiques rendent compte de la façon dont les espaces sont conçus et contribuent à déterminer l’appropriation des espaces publics.

« Au sein de la ville, la récolte de plus en plus massive de données affecte la définition de la norme. »

LFDLC : Dans un contexte où nos téléphones portables permettent de nous géolocaliser en continu et où des dispositifs de surveillance vidéo sont déployés massivement dans les villes, peut-on demeurer anonyme dans l’espace public ?

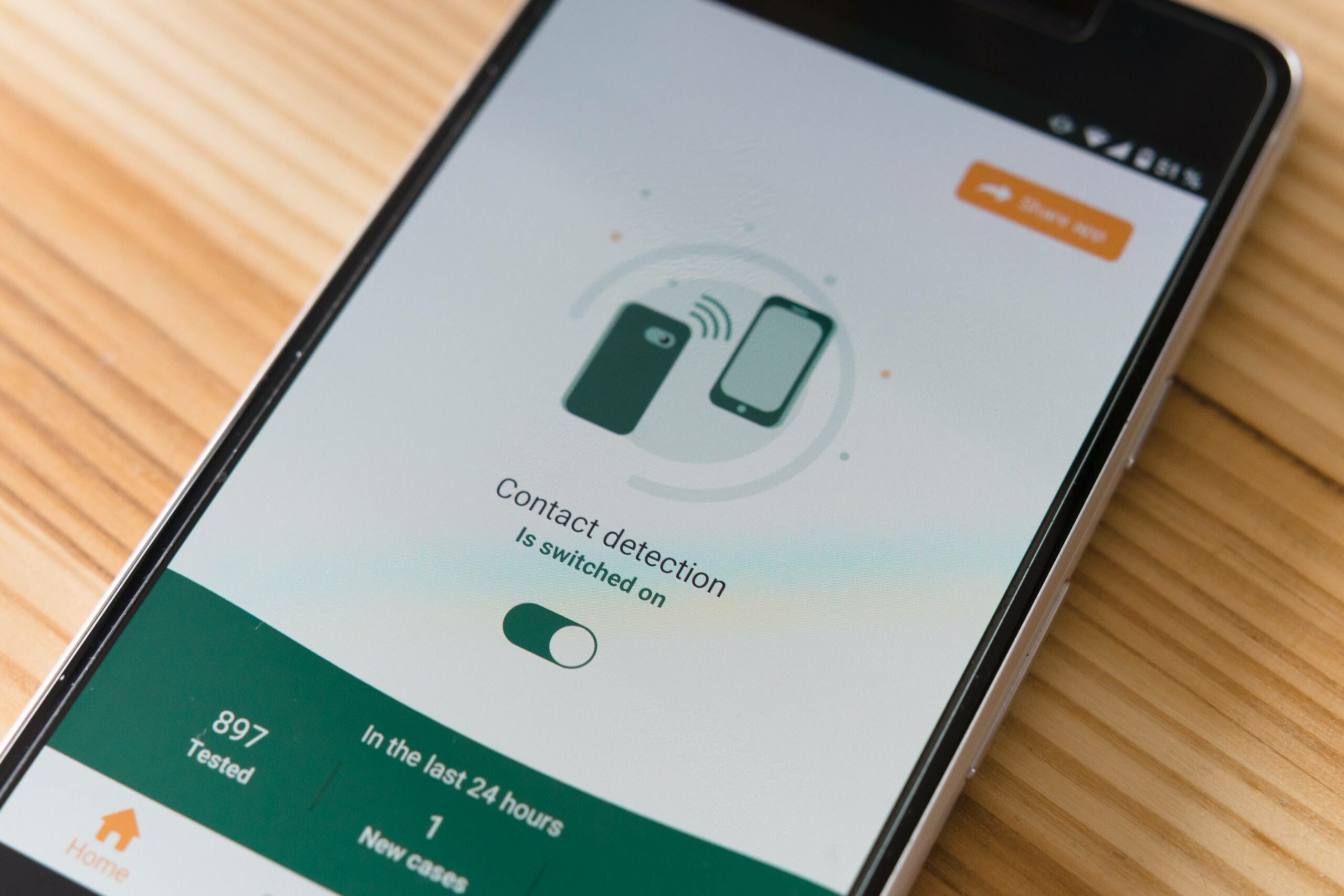

Régis Chatellier : La CNIL a publié en octobre 2017 un cahier « Innovation et Prospective », intitulé La plateforme d’une ville, dans lequel nous nous demandions s’il était possible, un peu à la manière de nos navigateurs Internet, d’envisager un mode « navigation privée » dans l’espace public. Car on se rendait bien compte, alors que la reconnaissance faciale n’était pas un sujet central à l’époque, qu’avec la multiplication des données récoltées dans la ville, on pouvait potentiellement suivre toutes nos allées et venues, notamment grâce à la géolocalisation. Il est d’ailleurs utile de rappeler que le premier capteur est celui que nous avons tous dans notre poche et qu’avec le smartphone nous nous dotons d’une infrastructure rendant possible notre propre surveillance. Dans ce cahier, nous mettions en avant le fait que la notion d’anonymat dans les espaces publics devrait être d’autant plus centrale dans les débats qu’elle s’évanouit progressivement.

Aujourd’hui, avec la reconnaissance faciale dans l’espace public, nous passons un nouveau cap puisqu’il ne s’agit plus seulement de récolter des données personnelles relativement classiques, telles celles qu’on obtient avec la géolocalisation. Les données biométriques, que la reconnaissance faciale permet d’extraire, sont des données personnelles sensibles car elles sont relatives aux attributs physiques d’un individu. Afin de reconnaître l’individu, le système doit en effet enregistrer un gabarit biométrique, dressé à partir d’une forme géométrique fondée sur des éléments du visage. À partir de ce fichier, pour effectuer de la reconnaissance faciale dans l’espace public, il faut que le système établisse des correspondances et un « match » dans une base de données potentiellement très importante, qui pourrait à terme regrouper toute la population. Cela implique alors de nombreux risques, à commencer par celui de la cybersécurité, puisque cette base de données pourrait un jour être piratée et ces informations pourraient fuiter, et ce d’autant plus facilement si elle est centralisée.

« Il est d’ailleurs utile de rappeler que le premier capteur est celui que nous avons tous dans notre poche et qu’avec le smartphone nous nous dotons d’une infrastructure rendant possible notre propre surveillance. »

LFDLC : Les technologies de reconnaissance, qui sont actuellement au stade d’expérimentation en conditions réelles, sont-elles fiables ?

Myrtille Picaud : Au-delà des biais des algorithmes, qui reconnaissent notamment particulièrement mal les personnes noires et les femmes, la fiabilité des systèmes de reconnaissance faciale demeure pour l’instant limitée. Les chiffres publiés par la South Wales Police en 2017 sont particulièrement parlants à cet égard. Durant certains grands événements, notamment certains matchs de football de la Ligue des champions, une technologie de reconnaissance faciale a été expérimentée et il s’est avéré que 93% des alertes étaient en réalité des « faux positifs », c’est-à-dire que l’algorithme annonçait avoir reconnu dans le public une personne recherchée alors qu’il ne s’agissait pas de la même personne – donc seulement 7% de vrais positifs. Il est assez inquiétant d’envisager que des systèmes aussi peu efficaces, quand bien même ils ont évolué depuis la publication de ces chiffres, puissent, à terme, être utilisés à des fins policières. Mais ce que soulignent également ces déploiements, a fortiori lors de grands événements festifs comme des matchs ou des concerts, c’est la banalisation sociale du recours à la reconnaissance faciale dans l’espace public. Qu’elle soit envisagée à des fins policières ou commerciales, celle-ci pose de nombreuses questions politiques.

Régis Chatellier : La reconnaissance faciale est effectivement un système probabiliste. Si on le règle de façon très stricte à partir du gabarit biométrique d’un individu, il sera incapable de l’identifier sans une photo d’une excellente qualité. À l’inverse, un réglage trop souple impliquera de nombreux faux positifs. Une expérimentation effectuée lors du festival de Notting Hill à Londres en 2017 avait ainsi généré 98% de faux positifs[1].

LFDLC : La récolte de plus en plus massive de données (notamment biométriques) dans l’espace public ne risque-t-elle pas de conduire à privilégier la sécurité au détriment des libertés des individus ?

Myrtille Picaud : Les enjeux du déploiement des systèmes de reconnaissance faciale, qui sont un aspect des projets de safe cities, sont à réarticuler dans une question très large : comment penser la surveillance ? Foucault distinguait deux types de dispositifs. Pour le dire rapidement, le dispositif de sécurité concerne l’ensemble de la population et s’appuie sur des outils qui définissent une norme, au sens statistique. En fonction de ce constat statistique, des groupes de population seront ciblés parce qu’ils sont en dehors de cette norme ; on va tenter de les ramener dans la norme. Ce dispositif n’exerce pas nécessairement de coercition directe, contrairement au dispositif disciplinaire, auquel il peut être articulé. Ce dernier, dont l’exemple type est la prison, s’applique à un individu jugé déviant et impose une contrainte sur son corps, dans un espace et un temps précis. Il cherche à le faire rentrer dans une norme qui est définie par rapport à des valeurs, par rapport à ce que l’on considère comme étant un bon comportement. Ces normes et dispositifs s’exercent dans des rapports de pouvoir entre groupes sociaux et ciblent donc davantage certains d’entre eux, par exemple les classes populaires, les groupes racisés, etc.

Dans la ville, on observe un certain nombre de dispositifs qui mêlent aspects disciplinaires et de sécurité. Par exemple, la cartographie de la criminalité est un outil de sécurité, qui permet de cibler certains quartiers où le taux de criminalité serait plus élevé, afin de les ramener dans la norme statistique. Ceci entraînera des mesures disciplinaires car le déploiement massif de forces de police impliquera plus de contrôle, menant éventuellement à des amendes voire des arrestations. Penser cette articulation entre discipline et sécurité dans l’espace public permet d’envisager la surveillance comme méthode de gestion de la population et pas uniquement comme un dispositif qui s’appliquerait à un individu. L’objectif de ces dispositifs n’est pas uniquement d’exercer une contrainte sur les personnes ; il s’agit aussi de gérer l’ensemble de la population par la récolte de données, en ciblant les espaces et groupes sociaux inégalement. J’ajouterais, par ailleurs, à propos des cartographies mentionnées qui servent aujourd’hui à la rationalisation de l’activité policière (voir les travaux de Bilel Benbouzid), qu’elles sont très problématiques. Par exemple, dans un quartier identifié comme ayant un taux de criminalité supérieur aux autres, l’accroissement du contrôle policier peut conduire à l’augmentation des données recensant des infractions. Leur traitement algorithmique peut ensuite conduire à un cercle vicieux, qui provoque un sur-ciblage de ce quartier et le contrôle de certaines populations considérées comme « à risque », renforçant ainsi des phénomènes sociaux qu’on observe par ailleurs.

« L’objectif de ces dispositifs n’est pas uniquement d’exercer une contrainte sur les personnes ; il s’agit aussi de gérer l’ensemble de la population par la récolte de données, en ciblant les espaces et groupes sociaux inégalement. »

Régis Chatellier : Pour l’instant, les systèmes de reconnaissance faciale ne peuvent pas être utilisés à des fins régaliennes en France. Cela ne pourrait se faire sans une évolution dans la législation, qui encadre le seul usage de la vidéo, sans technologies de reconnaissance. En septembre 2018, prenant compte du développement de ces technologies et de leur possible usage dans l’espace public, la CNIL a exprimé la nécessité d’engager un débat public afin d’envisager un cadre légal qui doit trouver un équilibre entre sécurité et protection des droits. Pour rendre possible l’utilisation de la reconnaissance faciale dans l’espace public, il faudrait une loi ou un décret en Conseil d’État mais, si les grands enjeux ne sont pas posés clairement sur la table, nous prenons le risque d’une décision trop hâtive et d’une législation qui ne serait pas suffisamment respectueuse des libertés individuelles.

Myrtille Picaud : Ce débat est d’autant plus urgent qu’un certain nombre d’acteurs publics et privés, notamment du monde de la sécurité, souhaiteraient une autorisation de la reconnaissance faciale dans l’espace public d’ici les Jeux Olympiques de 2024. Idéalement pour eux, l’autorisation serait déclarée avant 2023, afin que la coupe du monde de rugby permette de roder des systèmes qui seraient pleinement opérationnels pour les Jeux.

LFDLC : Dans l’ensemble, la smart city se dirige-t-elle vers une ville de la surveillance de masse ?

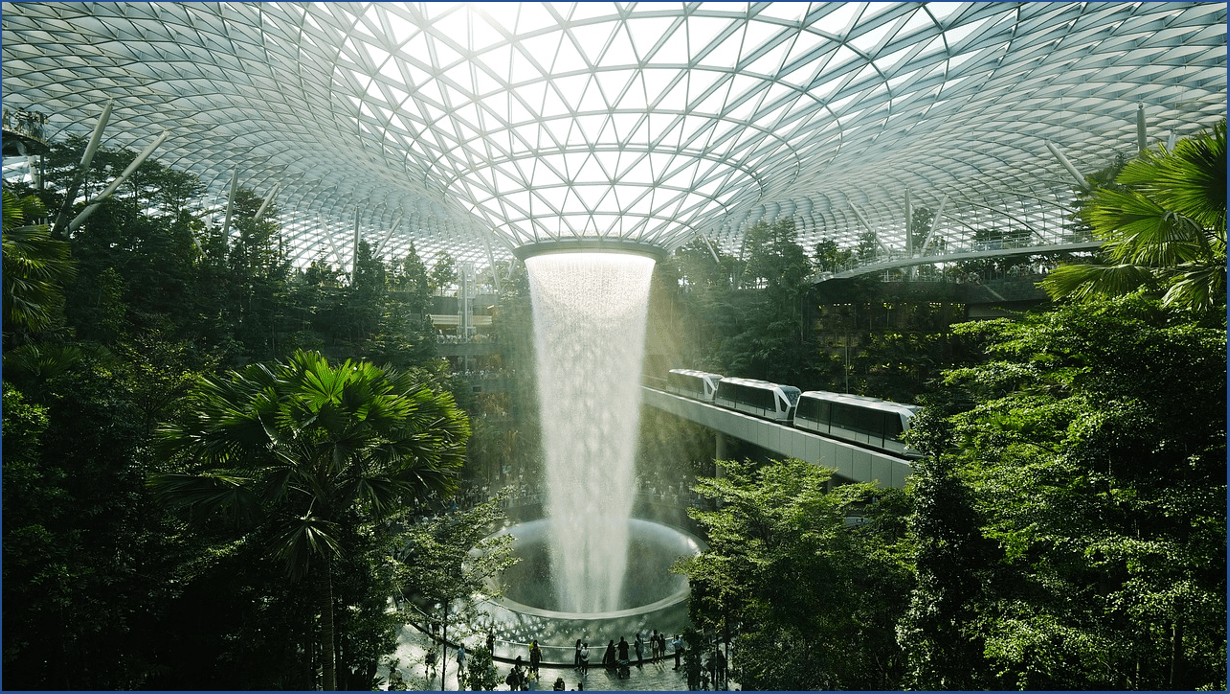

Régis Chatellier : Un des grands rêves de la smart city, formulé dès les années 1960 même si le terme n’existait pas encore, était de monitorer l’ensemble de la ville. Cela semble possible dans des États où les acteurs privés n’ont d’autre choix que de collaborer avec le public, comme en Chine. Là-bas, un système extrêmement poussé de contrôle social est envisageable car le secteur privé est au service de l’État. Dans des régimes plus démocratiques, la multiplicité des acteurs assure tout de même l’impossibilité d’une surveillance globale, régie par un seul acteur.

Myrtille Picaud : Comme mentionné plus tôt, l’un des risques, avec le développement de toujours plus de dispositifs de sécurité dans l’espace public, concerne les inégalités socio-spatiales, qui s’accompagnent d’une stigmatisation des quartiers populaires ou de certains groupes sociaux sur lesquels le contrôle s’accroît en priorité. Par ailleurs, la banalisation de ces dispositifs de sécurité va également de pair avec le développement d’une culture de l’anticipation, de la prédiction, ou de la « vigilance », selon les termes d’Emmanuel Macron, qui transforme nos représentations et nos pratiques.

LFDLC : Existe-il de grands mouvements de contestation de la potentielle fin de la vie privée dans l’espace public ?

Régis Chatellier : Il n’existe pas de grands mouvements de contestation, même si on observe un secteur associatif actif, animés par des structures comme Privacy International ou la Quadrature du net en France. Un parallèle avec la question de l’écologie pourrait être fait. Le sujet peut parfois paraître trop lointain pour que les individus s’en préoccupent vraiment. Ils savent qu’un risque existe mais n’en prennent pas véritablement la mesure tant qu’ils n’y sont pas personnellement confrontés. Sur la question des données, la logique est la même : à moins d’être identifié par erreur par un outil de reconnaissance faciale ou soumis à un biais algorithmique, nous n’avons pas pleinement conscience de l’importance du débat. Mon propos pourrait cependant être nuancé, dans la mesure où la vidéosurveillance fait l’objet de la majorité des plaintes reçues par la CNIL. Mais ces dernières restent de l’ordre d’actions individuelles, il n’y a pas à ce stade de mouvement de foule important, alors que le rôle de la société civile est central sur ces questions.

Myrtille Picaud : Je partage le même constat, il n’y a actuellement pas de mouvement de résistance massif autour de la question de la reconnaissance faciale, quoique la Quadrature du Net se mobilise actuellement sur ces questions. Cette moindre politisation peut peut-être s’expliquer par la plasticité de l’appropriation des technologies. Dans son ouvrage L’œil sécuritaire, la sociologue Élodie Lemaire montre que la vidéo-surveillance, développée initialement dans un but sécuritaire, a fait l’objet d’usages divers. Par exemple, la vidéo-surveillance dans les magasins ou les transports peut parfois contribuer davantage à surveiller les travailleurs que les « délinquants ». Une même technologie fait ainsi l’objet d’usages différenciés, selon des logiques variables, ce qui suppose des résistances qui se manifestent de façons diverses, parfois à bas bruit.

Ces autres publications peuvent aussi vous intéresser :

Cahors : innover pour une qualité de vie remarquable

Virage à 180°

Derrière les mots : la smart city

Derrière les mots : l’espace public

Une rue nommée désir

Portrait de ville – Toronto : jusqu’où ?

Yearbook 2019 – L’accélération

Toronto : jusqu’où ?

Le numérique pour renouveler la démocratie locale ? Le point de vue d’Ornella Zaza

Viktor Mayer-Schönberger : quel rôle pour le « big data » en ville ?

Vienne et la « smart city » : l’analyse de Thomas Madreiter

La Fabrique de la Cité

La Fabrique de la Cité est le think tank des transitions urbaines, fondé en 2010 à l’initiative du groupe VINCI, son mécène. Les acteurs de la cité, français et internationaux, y travaillent ensemble à l’élaboration de nouvelles manières de construire et reconstruire les villes.